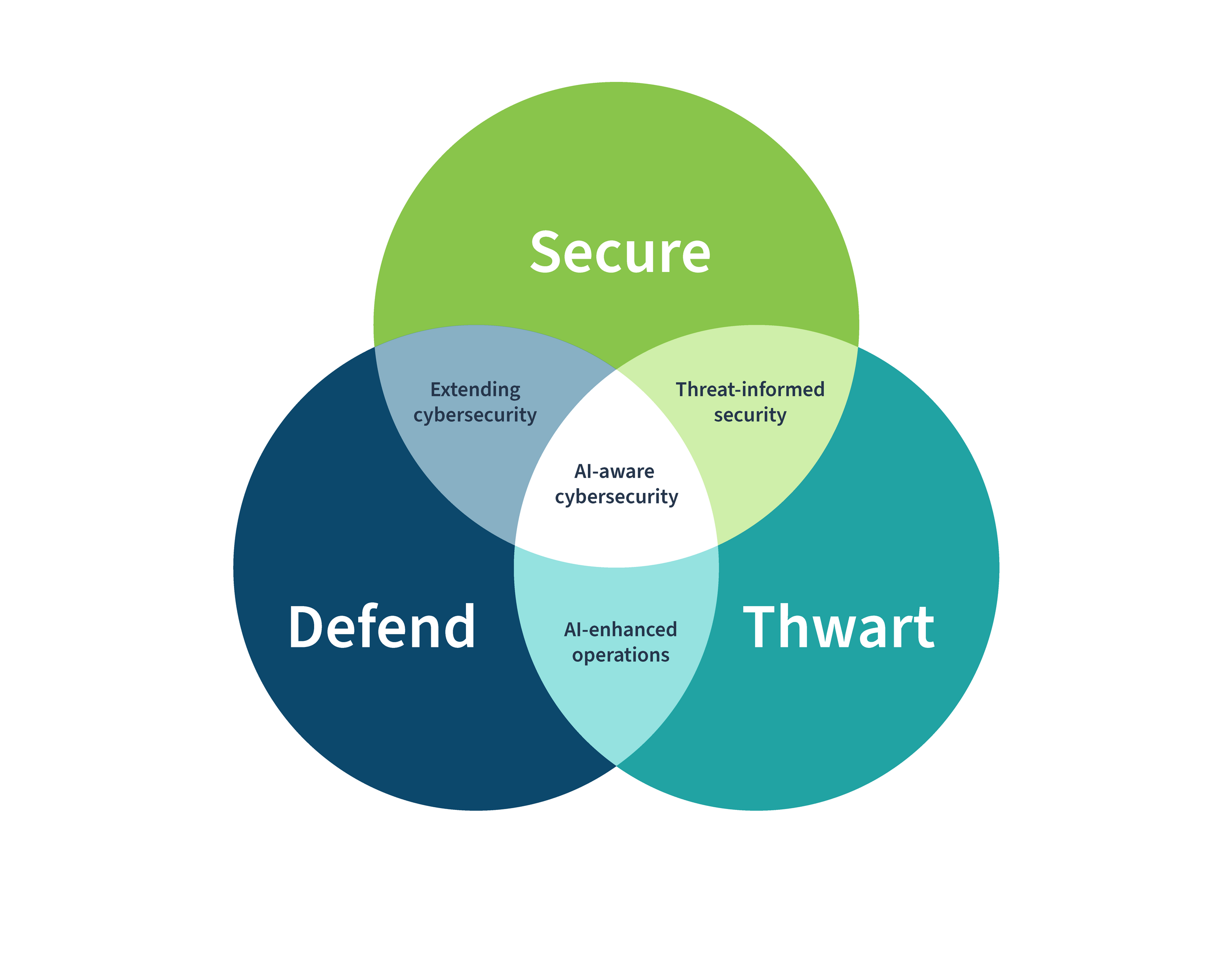

2025年12月16日,美国国家标准与技术研究院(NIST)发布了其广受关注的网络安全框架(CSF)在人工智能领域的首个应用指南草案——《网络安全框架人工智能配置文件(草案)》(Cybersecurity Framework Profile for Artificial Intelligence,文件编号NISTIR 8596),并向公众开放为期45天的意见征询。该指南旨在帮助组织将人工智能因素全面纳入现有的网络安全战略中,在加速采用AI技术的同时有效应对由此带来的新兴网络安全风险。根据NIST公告,草案文件提供了将新版NIST网络安全框架2.0与人工智能技术对接的方法和建议。该“AI配置文件”覆盖了三个相互重叠的重点领域:确保AI系统自身的安全、利用AI增强网络防御以及防范AI驱动的网络攻击。文件将上述三个领域分别简称为“安全”(Secure)、“防御”(Defend)和“阻断”(Thwart),并针对每一领域给出了详尽的控制措施建议,指导组织识别AI融入业务后在入侵检测、供应链安全、漏洞管理等各方面的新考虑。NIST指出,该配置文件旨在帮助组织充分理解和审视AI相关的网络安全隐患,并将AI技术审慎且周全地集成到其网络安全策略和体系中。

这一AI网络安全框架草案的发布,标志着网络安全与人工智能治理的进一步融合。在人工智能应用日益普及的背景下,网络攻击者可能利用AI生成更具威胁性的攻击手段,而企业也希望利用AI提升防御效率。NIST推出的指南为这种“双刃剑”提供了平衡之道:一方面帮助机构强化自身AI系统的安全设计,防止AI模型被对抗性攻击或数据投毒等威胁;另一方面鼓励机构将AI技术用于网络威胁检测和响应,提升防御能力。NIST专家指出,随着AI以不同方式进入组织的业务领域,最终每个组织都不得不同时面对保障AI安全、运用AI防御和防范AI滥用这三重挑战。因此,提前建立针对AI的安全策略显得尤为重要。此份草案也被视为对NIST既有人工智能治理框架的有益补充。近年来NIST在AI风险管理方面动作频频:2023年发布了《人工智能风险管理框架(AI RMF)》,2024年又推出了生成式AI风险管理配置文件,2025年8月发布了利用现有安全控制保障AI系统的指南。而本次推出的AI网络安全配置文件,进一步细化了AI技术融入网络安全实践的方方面面,体现出美国政府对AI安全问题的高度重视。例如,美国总统拜登曾指示NIST制定AI安全测试和生成内容标识等标准,以加强对AI潜在风险的管控。这份指南草案正是回应此类政策要求的举措之一,也为各机构满足未来法规要求(如AI安全评测标准)提前做好准备。业界分析认为,NIST的这一AI安全框架将在最终定稿发布后,为企业部署和利用人工智能提供一份权威的“安全说明书”。通过遵循该指南,组织有望在充分挖掘AI价值的同时,将网络安全风险降至最低,从而在增强自身安全韧性的同时,提升客户和公众对AI应用的信心。

有意向参与标准工作的企业请与标准编制工作组联系:

标准部常务副部长郑美惠 17820723480

标准化工程师杨铭源 13378049306

标准化工程师曾君豪 19256691589